AI 生成的博客文章质量低下,这是不少人的共识。他们认为 AI 天然不如人类创作的内容。

那些大规模使用 AI 生成内容的公司心里清楚,自己在做权衡——为了速度和规模而牺牲质量。AI 确实比任何人都快,也能产出差强人意的初稿,但使用 AI 总会牺牲某些重要的东西。

现在我认为这种观念已经过时了。生成式 AI 已经能够创作出与过去内容营销人员(包括我本人)所生产的海量人类内容难以区分的作品。

AI 已经成为更彻底的研究者,更顺从地遵守品牌调性和风格指南,对反馈的响应更灵活,速度更快,效率更高。使用 AI 进行内容创作不再需要做出权衡。

这并不是说所有 AI 内容天生就是好的,只是说阻碍 AI 内容达到优秀水平的障碍已经消除了。通过 LLM 获取世界级写作能力的机会仍然不均衡,但这种状况不会持续太久。对所有人来说,功能上“完美”的 AI 内容即将成为现实,我们有必要承认这一点。

原因如下。

优秀的写作比想象中更简单

许多人认为人类写作中存在某种内在品质是 AI 永远无法企及的——某种永远无法被我们的硅基同行触及的创作火花。

我不会声称 AI 能接近莎士比亚的深度,但我会说“优秀写作”比大多数人想象的更简单、更机械化。“优秀写作”的大部分构成要素都是 LLM 非常、非常擅长的事情。

我的整个职业生涯都在通过对写作过程的反思来试图成为更好的写作者,追问为什么有些东西有效而有些无效。我不是这个领域的专家,但我形成了一套关于写作机制的有效世界观,以及一套我反复遵循的写作原则。

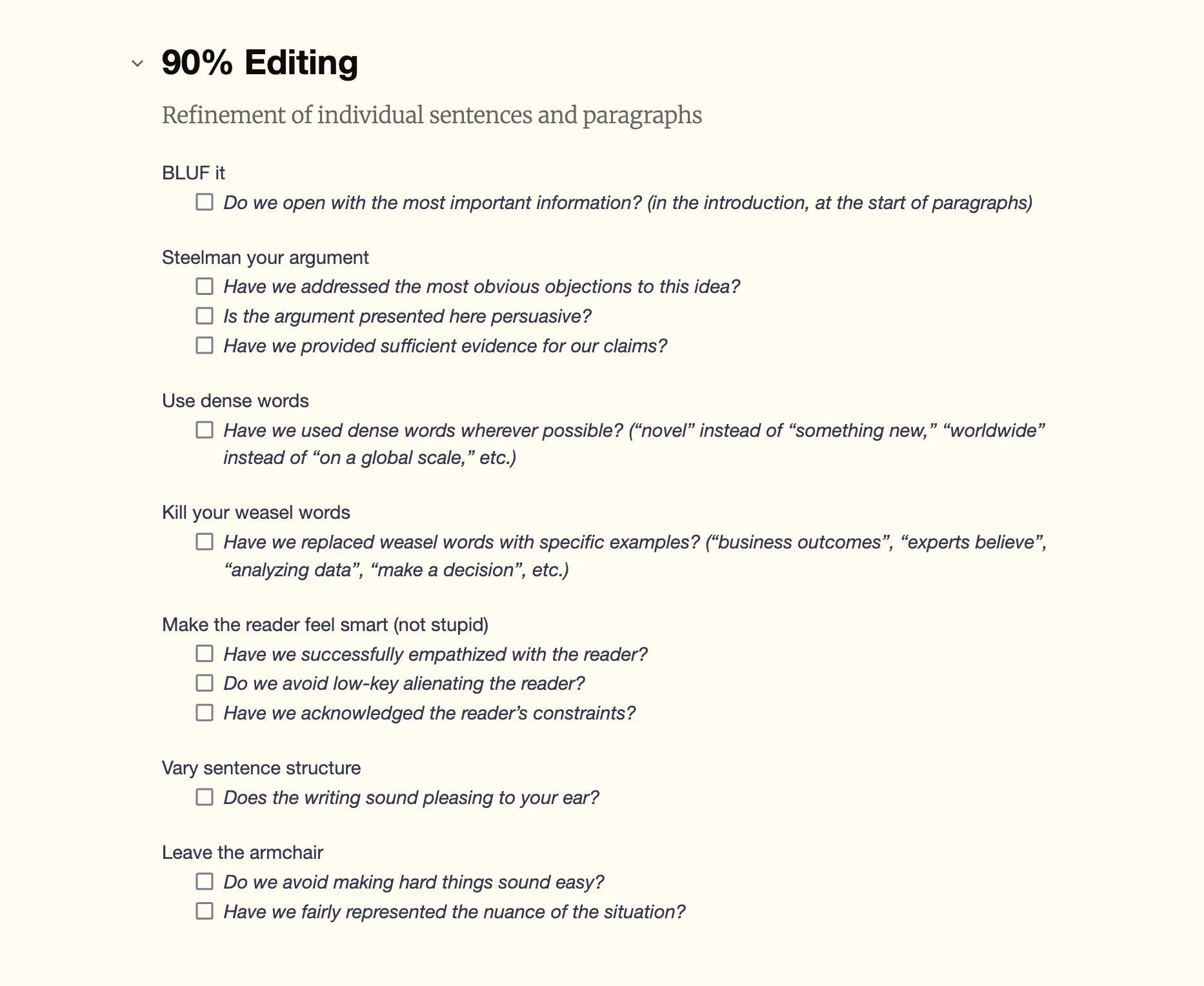

这是我的编辑检查清单的一小部分,用于培训新写手。

例如,以下是我编辑检查清单中的一些随机摘录:

- 我们是否已经回应了对这个想法最明显的反对意见?

- 我们是否在可能的情况下使用了更精炼的词汇?(用“novel”代替“something new”,用“worldwide”代替“on a global scale”等)

- 我们是否用具体例子取代了模糊措辞?(“business outcomes”、“experiences believe”、“analyzing data”、“make a decision”等)

- 我们是否避免把复杂的事情写得过于简单?

- 我们是否在开头就呈现最重要的信息?(在引言中,在段落开头)

- 等等。

这些原则就是我的写作方式、编辑方式和教学方式。它们非常简单,但协调执行下来,最终成果往往相当不错,甚至是优秀的写作。

这些原则简单到 LLM 可以完美执行——而且通常比我执行得更好。我经常因为疲劳、倦怠或懒惰而不能一致地应用这些原则。但对于 LLM,这些原则可以设置一次,然后无限期地遵循。它们可以被均匀地扩展到数百、数千甚至数百万个输出,编入系统提示和 SKILL 文件中(下一节将详细讨论)。

如果你承认优秀写作存在基本配方(我相信确实存在),LLM 可以很好地遵循它。把许多这样的启发式方法可靠地串联起来,你就能构建一个出色的 AI 写作流程。

而且,我们终于有了实现这一点的技术。

AI 比看起来更复杂

对于许多人来说,他们对 AI 的认知仍然停留在聊天体验层面。但 LLM——更重要的是,围绕它们的基础设施——在近几个月已经取得了巨大进步。

即便在早期阶段,大语言模型在某些小领域就已经展现出超越人类的聪明才智火花。但就像一个聪明的孩子模仿父母的行为却并不真正理解其含义一样,很难想象这些火花能演变成真正的写作能力。

写出几句连贯的话似乎与可靠地生成数千字准确、有用、简洁、符合品牌调性的内容相去甚远;与识别和填补主题空白、理解主流搜索意图、差异化竞争文章等也相去甚远。

当我写到我之前的 AI 写作流程(使用基于我编辑原则的自定义 GPT)时,输出中确实看到了许多智慧的火花,但最终产品仍然依赖人工干预才能完成。

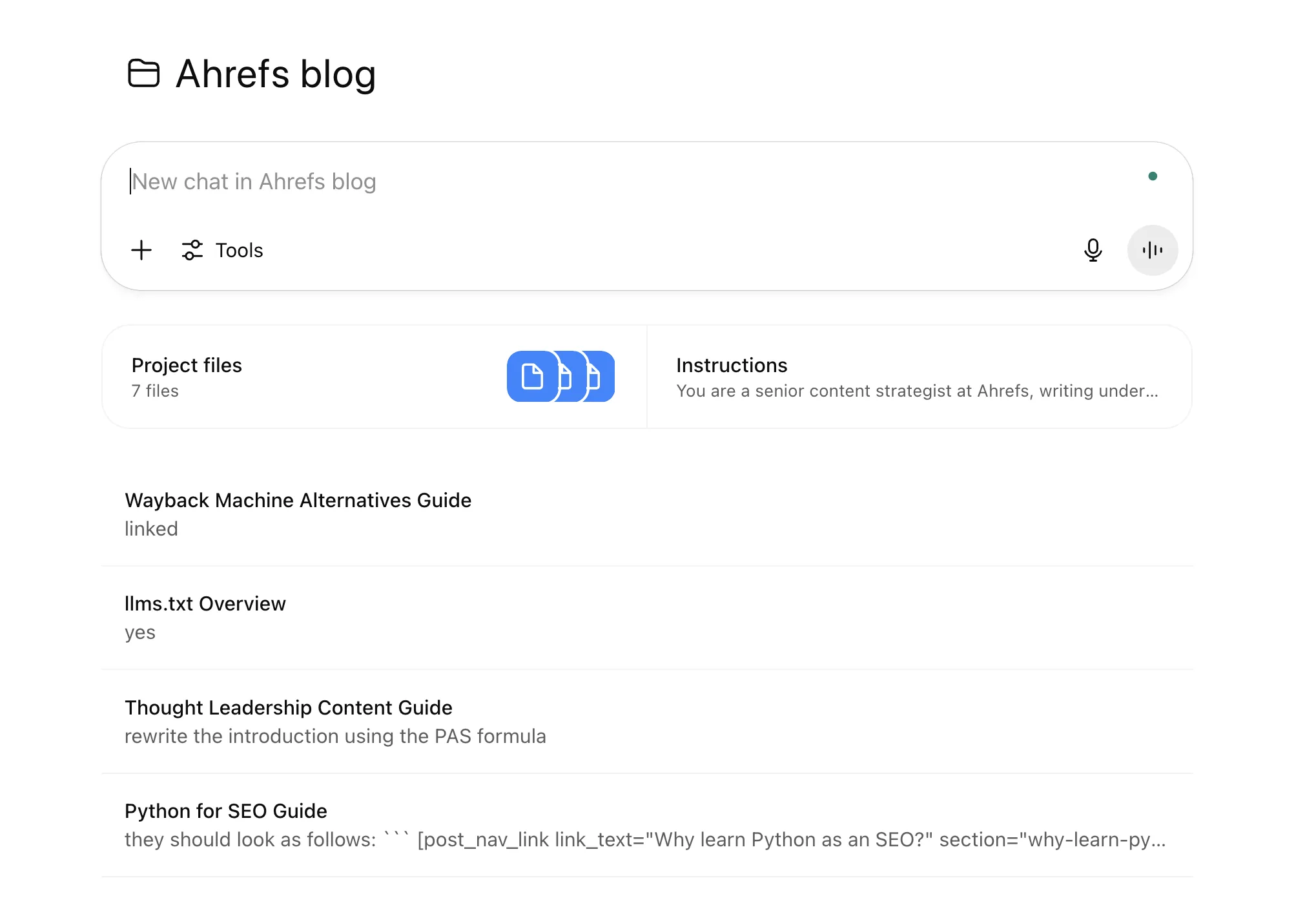

我们早期版本的 AI 内容管道,使用 ChatGPT 项目和自定义 GPT 构建。

但这种情况已经不复存在了。仅七个月后,那个流程的局限性就已经消失。如今,我每月 20 美元的 Claude 订阅提供了几乎像科幻小说一样的能力。我可以:

- 将多个 LLM 流程串联成一个连续的工作流(Claude Code、OpenAI Codex 和其他代理模型)。

- 提供护栏来避免 LLM 通常遵循流程(SKILL)时出现的大量概率性“摇摆”,并鼓励它们递归地基准测试自己的性能和自我改进。

- 将 AI 集成到其他工具的现有工作流中(MCP)。

- 将内容扎根于研究体系、现有写作样本、语气风格、品牌指南(RAG、memory、context)。

(这还没有考虑到旗舰模型本身近几年的显著改进。)

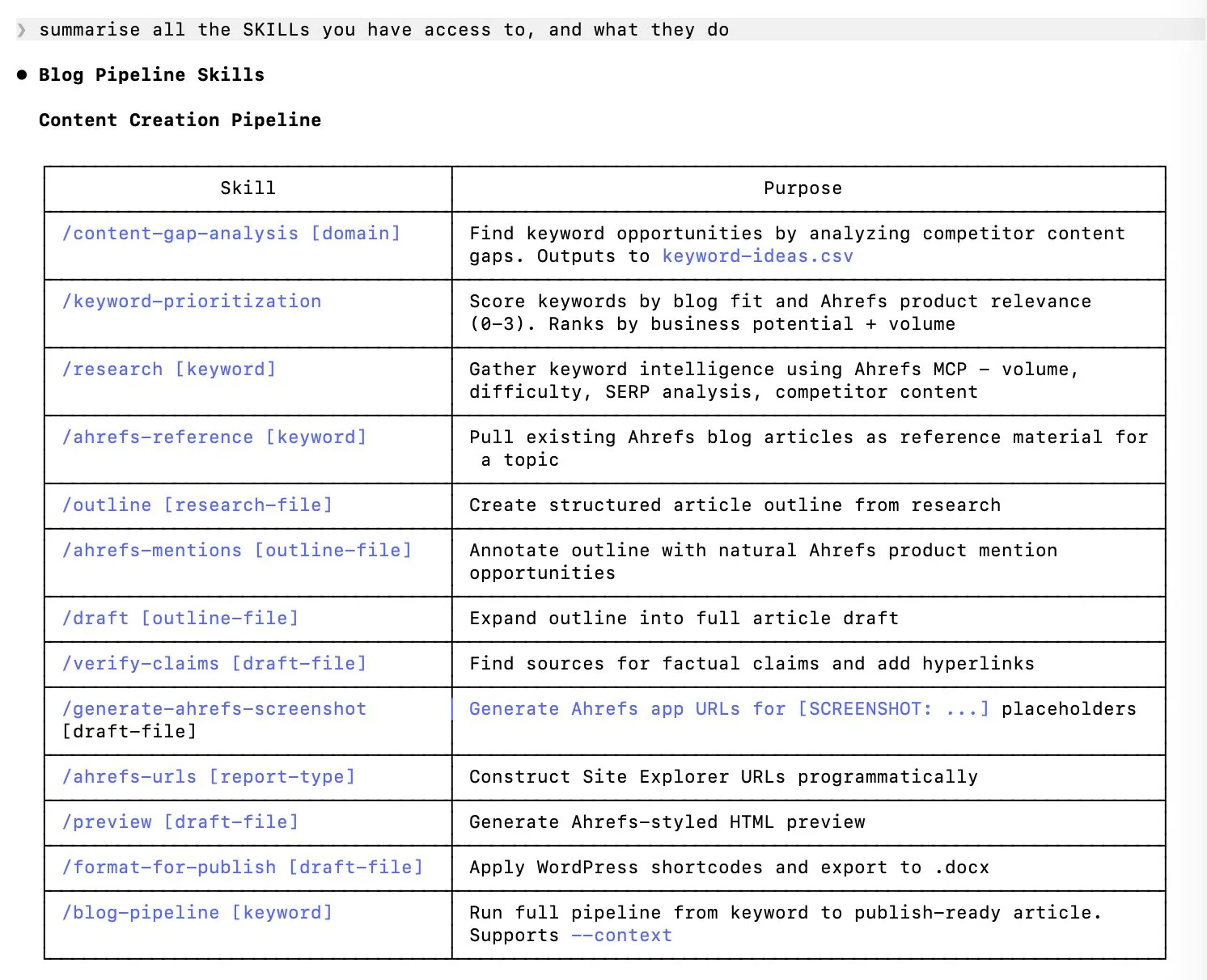

我们为 Claude Code 构建的一些自定义 SKILL 文件。

过去一年开发的所有 vibe-coding 基础设施对 LLM 的实用性产生了变革性影响。LLM 仍然是“仅仅”复杂的自动补全——我们当然还没有实现 AGI——但 Anthropic 和 OpenAI 等公司成功地将这种行为转化为一种似乎比其各部分之和更有用的方式。

而且重要的是,摆在他们面前的任务——内容营销——并不特别复杂。

延伸阅读

内容营销比想象中更简单

大多数内容营销人员将大部分时间用于创建信息性、关键词导向的内容:有用的“操作指南”文章或对比列表。这些是内容营销经过时间考验的典型形式,创建起来通常相当直接。

和之前一样,我认为有效的搜索内容存在基本配方。以下是我们在搜索内容中尝试遵循的一些核心原则:

- 满足主要搜索意图

- 基于现有搜索结果中的共识进行构建

- 填补你与竞争对手文章之间明显的主题空白

- 添加超越现有结果的新颖信息

- 参考你已创建的关于该主题的任何相关内容

- 参考任何可能帮助读者继续探索的相关外部内容

- 优先考虑能让你自然提及产品的主题

- 确保文章结构互斥且穷尽

- 确保文章结构真正兑现标题的承诺

- 用标题和引言吸引读者的兴趣

- 在文章重要部分自然地包含关键词及其变体

- 等等。

这些同样是简单的概念,汇总起来就是有效的搜索内容。如果一个人能够遵循这些流程,他们的搜索内容通常会表现良好。LLM 也是如此。如果 Opus 4.6 或 GPT 5.4 能够遵循这些流程,它们的输出也会表现良好。

即使是这些流程中最不透明的部分,对于 LLM 来说也相当容易遵循,可以通过提供明确的步骤(“使用 WebFetch 运行 ahrefs.com/blog 的 site: 搜索并返回前三篇文章…”)、期望输出的示例(就像你最喜欢的文章引言的参考文件),或访问可信数据源(如 Ahrefs MCP)。

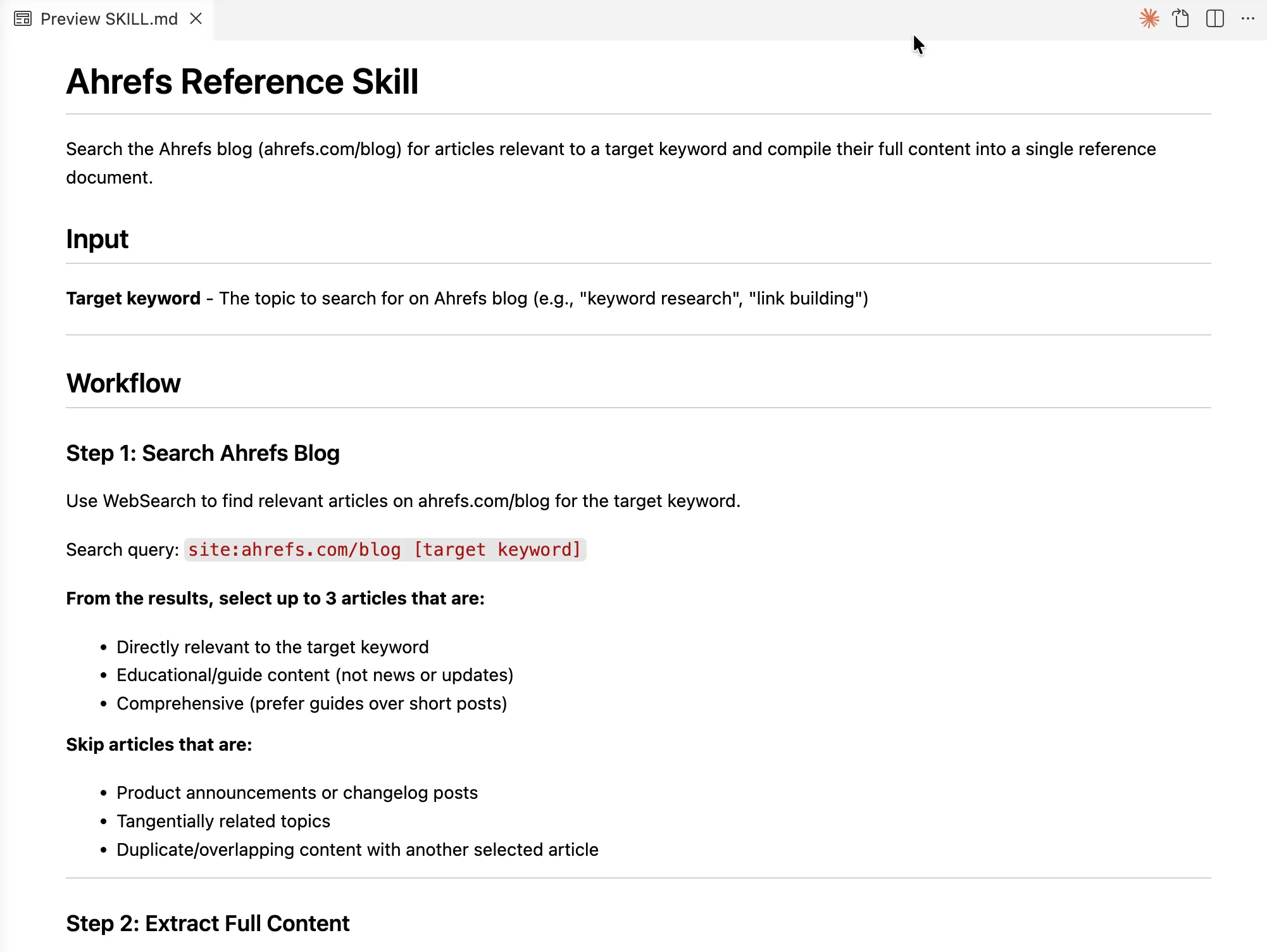

用于检索给定关键词现有 Ahrefs 内容的 SKILL 文件预览。

无论我们是否愿意承认,有效的搜索内容高度模式化(这也正是摩天大楼法成功的原因)。不需要复杂的创新,不需要诗歌,也不需要与搜索结果唱反调。

虽然存在一些创新和实验的空间,但比你想的要少:偏离奥普廷窗口太远通常会降低效果,而不是提升效果(这是我多次尝试创作“聪明”的搜索内容失败后得出的结论)。

如果 Claude 能重构十万行代码,那么假设大语言模型无法写出一篇优秀的搜索优化内容似乎就有些傲慢了。AI 写不出莎士比亚,但它不需要。

结语

无论你说服了你与否,在撰写本文时,我已经将工作中相当大的一部分外包给了生成式 AI。我使用 Claude Code、Ahrefs MCP 和约 15 个自定义 SKILL 文件,按顺序串联起来,用于更新旧文章并创建有用的高质量内容。

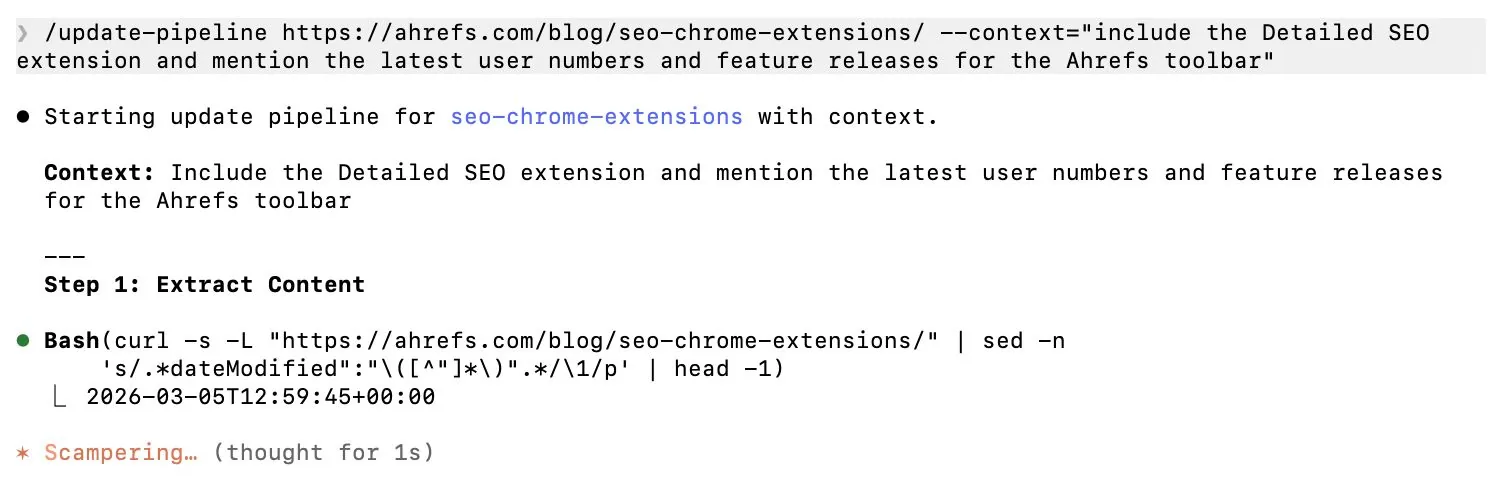

Claude 开始执行内容更新流程。

这些文章读起来一样,表现一样,包含我的经验和视角。它们和我能写出的任何东西一样好;甚至更好,因为否则我根本没有时间创作它们。没有权衡。

在使用生成式 AI 发挥最大潜力的熟练写作者与普通用户 prompting ChatGPT “写一篇博客文章”之间,可能达到的质量仍然存在巨大差距。

但这个差距已经比过去小了很多;随着 AI 平台持续开放所有这些功能的访问权限,这个差距最终会消失。“内容工程师”的技能将成为每个主流 LLM 平台的另一个工作流。对所有人来说,功能上“完美”的 AI 内容即将成为现实。

我可以放心地提出这个论点,因为我的工作中还有很多部分仍然无法外包给 AI;还有一部分是我不愿意外包的,即使可以(比如这篇文章)。

只有诚实地承认 AI 在哪些地方可以、应该被使用,我们才能找到前进的道路。直到最近,AI 内容还不够好。现在,它已经足够了。我们越早承认这一点,就能把更多时间投入到人类将在更长时间内做得更好的营销领域。

(我并不想念写摩天大楼内容的那种感觉。)

延伸阅读

原文链接

https://ahrefs.com/blog/ai-content-wasnt-good-enough-now-it-is/本文为译文,如有侵权请联系删除